안녕하세요, 솔론입니다.

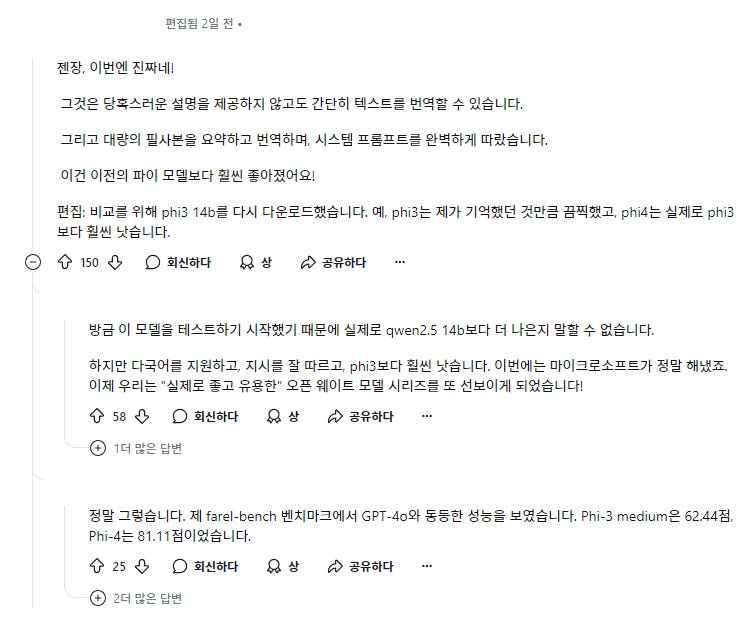

이번 주 내에 공개 예정이던 마이크로소프트의 phi-4의 양자화 버전이 트렌드에 올라왔습니다.

정작 원본인 마이크로소프트의 repo는 phi-4가 업데이트되지 않았던데 어떻게된건지 모르겠습니다…

일단 양자화된 phi-4의 repo의 모델 설명은 비어있으며, reddit의 반응도 phi-4 같다는 반응인데… 무슨 상황인지 모르겠습니다…

그럼 이제 오늘 [2024-12-15]의 트렌드 변화를 확인해보겠습니다.

자세한 내용들은 TrenDevSophy에서 확인해주세요.

----새로 등장한 트렌드----

matteogeniaccio/phi-4:

모델 카드가 제공되지 않았습니다.

LeMaterial/LeMat-Bulk:

LeMat-Bulk 데이터셋은 Hugging Face에서 제공하는 화학 물질 관련 데이터셋입니다.

약 670만 개의 자료 행을 포함하며, parquet 형식으로 저장되어 있습니다.

화학식, 결정 구조, 에너지 등 다양한 정보를 담고 있습니다.

Materials Project, Alexandria, OQMD 데이터를 포함하며, CC-BY-4.0 라이선스를 따릅니다.

데이터셋 사용 시, 해당 라이선스 및 출처를 명확히 밝혀야 합니다.

AI-MO/NuminaMath-CoT:

본 데이터셋은 약 86만 개의 수학 문제와 각 문제에 대한 사고 과정(CoT) 형식의 풀이를 담고 있습니다.

데이터 출처는 중국 고등학교 수학 문제, 미국 및 국제 수학 올림피아드 문제 등 다양합니다.

데이터 처리 과정은 PDF에서 OCR, 문제-풀이 쌍 분리, 영어 번역, CoT 형식 재정렬, 최종 답변 형식화를 포함합니다.

Apache License, Version 2.0에 따라 이용 가능합니다.

데이터셋 크기는 1.23GB이며, 약 859,594개의 행으로 구성됩니다.

jianzongwu/MangaZero:

Hugging Face에서 제공하는 MangaZero 데이터셋은 텍스트-이미지 생성 작업에 사용됩니다.

데이터셋의 크기는 10,000개에서 100,000개 사이이며, JSON 형식으로 제공됩니다.

데이터셋은 만화 이미지와 해당 이미지에 대한 캡션, 캐릭터 정보, 대화 정보 등을 포함합니다.

캐릭터 정보에는 얼굴이 선명한 캐릭터(Type 0), 얼굴이 흐릿한 캐릭터(Type 1), 과장된 캐릭터(Type 2) 등의 유형이 있습니다.

관련 논문은 "DiffSensei: Bridging Multi-Modal LLMs and Diffusion Models for Customized Manga Generation"이며, GitHub 저장소에서 사용법을 확인할 수 있습니다.

----인사이트 확인하기----

일간 인사이트:

LLM(대규모 언어 모델)의 발전: 과거 Meta의 Llama 3.3-70B-Instruct와 같은 모델이 주목받았다면, 최근에는 Qwen2.5-Coder-32B-Instruct와 같이 코드 생성에 특화되고, 혹은 Athene-V2-Chat-72B처럼 GPT-4o와 유사한 성능을 보이는 모델이 등장하여, LLM의 특정 작업(코딩, 채팅)에 대한 성능 향상 및 전문화 추세를 보여줍니다. 모델 크기의 증가(70B 파라미터 이상)와 더불어 멀티모달 모델(이미지, 비디오 생성 및 이해)의 발전도 두드러집니다. 이는 업계에서 특정 분야에 특화된 고성능 모델 개발에 대한 수요가 증가하고 있음을 시사합니다.

멀티모달 모델의 확장: 과거에는 텍스트 기반 모델이 주류였지만, 최신 트렌드에서는 Lightricks/LTX-Video 와 같이 실시간 고품질 비디오 생성 모델, DeepSeek-VL2와 같이 비전-언어 모델 등 멀티모달 모델이 크게 발전하고 있습니다. 이는 AI가 텍스트뿐 아니라 이미지, 비디오 등 다양한 데이터를 처리하고 생성하는 능력이 중요해지고 있음을 의미하며, 멀티모달 AI 기술이 다양한 분야(예: 엔터테인먼트, 교육, 의료)에 적용될 가능성을 보여줍니다.

오픈소스 모델의 성장: 텐센트의 HunyuanVideo 와 같이 최첨단 성능을 가진 오픈소스 모델이 공개되면서, 오픈소스 생태계가 더욱 활성화되고 있습니다. 이는 AI 기술의 접근성 향상 및 다양한 개발자들의 참여를 통해 AI 기술 발전의 속도가 더욱 빨라질 것임을 시사합니다. 이는 상용 모델에 대한 의존도를 낮추고, 다양한 응용 프로그램 개발을 가능하게 할 것으로 예상됩니다.

데이터셋의 고도화: 과거에는 단순한 텍스트 데이터셋이 주를 이루었다면, 최근에는 MAmmoTH-VL-Instruct-12M, TIGER-Lab/OmniEdit-Filtered-1.2M 과 같이 이미지, 비디오, 그리고 다양한 작업(이미지 편집, 비디오 모션)과 관련된 데이터셋이 등장하고 있습니다. 이는 더욱 복잡하고 다양한 작업을 수행할 수 있는 AI 모델 개발에 필요한 데이터 수요의 변화를 보여줍니다. 고품질, 대용량 데이터셋 구축 기술의 발전이 AI 모델의 성능 향상에 중요한 역할을 할 것으로 예상됩니다.

효율성 및 최적화: 최신 모델들은 NexaAIDev/OmniAudio-2.6B처럼 기기 내 배포를 위한 효율성을 중시하는 추세를 보입니다. 이는 AI 기술의 실제 세계 적용을 위한 모델 크기 축소, 연산 속도 향상, 메모리 효율 증대 등이 중요해지고 있음을 의미합니다. 향후 AI 모델은 더욱 경량화되고, 다양한 하드웨어 플랫폼에서 효율적으로 작동할 수 있도록 발전할 것으로 예상됩니다.

특정 분야 전문화: 최신 트렌드는 Qwen2.5-Coder-32B-Instruct 와 같이 특정 분야(예: 코드 생성)에 특화된 모델 개발에 집중하고 있습니다. 이는 일반적인 목적의 모델보다 특정 분야에서 더 높은 성능을 달성하는 것이 가능함을 보여주며, 향후 AI 모델은 더욱 세분화된 전문 분야에 특화되어 개발될 것으로 예상됩니다.

라이선스 및 접근성: 오픈소스 모델의 증가와 다양한 라이선스 정책(MIT, Apache 2.0, Llama 커뮤니티 라이선스 등)의 존재는 AI 기술의 접근성 향상 및 생태계 활성화에 기여하고 있습니다. 하지만 상업적 이용에 대한 제한이나 윤리적 문제에 대한 고려도 중요해지고 있습니다. 향후 AI 모델의 라이선스 및 접근성 문제는 AI 기술의 발전과 윤리적 사용에 중요한 영향을 미칠 것으로 예상됩니다.

주간 인사이트:

과거 및 최신 트렌드 비교 분석을 통한 현재 업계 동향 인사이트:

* 대규모 언어 모델(LLM)의 지속적인 발전: 과거 트렌드와 최신 트렌드 모두에서 LLM의 파라미터 수 증가와 성능 향상이 두드러집니다. 특히, 70B 이상 파라미터를 가진 모델들이 등장하며 다국어 지원 및 다양한 작업(코딩, 이미지 생성, 비디오 생성 등)에 대한 성능이 크게 향상되었습니다. 이는 LLM이 단순한 텍스트 생성을 넘어 다양한 모달리티와 복잡한 작업을 처리하는 방향으로 발전하고 있음을 시사합니다.

* 다중 모달 모델의 부상: 과거에는 텍스트 중심의 모델이 주를 이루었지만, 최근에는 이미지, 비디오, 오디오를 함께 처리하는 다중 모달 모델이 주목받고 있습니다. FLUX, HunyuanVideo 등의 모델은 텍스트를 기반으로 이미지 및 비디오를 생성하며, Llama-3.2-11B-Vision-Instruct와 같은 모델은 이미지와 텍스트를 동시에 처리하여 시각적 질문응답 등의 작업을 수행합니다. 이는 AI가 단일 모달리티를 넘어 복합적인 정보를 이해하고 활용하는 능력을 강화하고 있음을 보여줍니다.

* 오픈소스 모델의 확산 및 생태계 조성: 과거에도 일부 오픈소스 모델이 존재했지만, 최신 트렌드에서는 Tencent의 HunyuanVideo와 같이 대규모의 고성능 오픈소스 모델이 공개되면서 오픈소스 생태계가 더욱 확장되고 있습니다. 이는 연구 및 개발의 민주화를 촉진하고, 더욱 다양한 응용 프로그램의 개발을 가속화할 것으로 예상됩니다.

* 효율성 향상 및 경량화: 모델의 크기가 증가함에도 불구하고, 8비트 및 4비트 양자화와 같은 기술을 통해 메모리 효율을 높이고, 경량 모델(ShowUI-2B, Oxy 1 Small 등)이 개발되면서 자원 제약 환경에서도 AI 기술을 활용할 수 있는 가능성이 커지고 있습니다. 이는 AI 기술의 접근성을 높이고, 실제 응용 분야에서의 활용도를 더욱 확대할 것으로 기대됩니다.

* 특정 분야에 특화된 모델의 등장: 과거에는 범용적인 LLM이 주로 개발되었지만, 최신 트렌드에서는 코드 생성(Qwen2.5-Coder-32B-Instruct), 이미지 편집(OmniEdit-Filtered-1.2M), 음성 합성(Fish Speech V1.5) 등 특정 분야에 특화된 모델들이 등장하고 있습니다. 이는 AI가 특정 분야의 문제를 더욱 효과적으로 해결할 수 있도록 전문화되고 있음을 보여줍니다.

* 데이터셋의 다양화 및 고품질화: 최신 트렌드에서는 다국어 지원, 다중 모달리티, 특정 작업에 특화된 등 다양한 목적의 고품질 데이터셋이 개발되고 있습니다. 이는 AI 모델의 성능 향상에 필수적인 요소이며, 앞으로도 데이터셋의 질과 양적 성장은 AI 발전에 중요한 역할을 할 것으로 예상됩니다.

* 강화 학습 및 미세 조정 기술의 발전: 최신 트렌드에서 강화 학습(RLHF)을 통해 모델의 성능 및 안전성을 향상시키는 기술이 발전하고 있습니다. 이는 모델의 응답 품질을 높이고, 부적절한 응답을 줄이는 데 기여할 것으로 예상됩니다.

* 업계의 협력 및 공유: 오픈소스 모델의 확산과 함께, 다양한 연구 기관과 기업들이 데이터셋 및 모델을 공유하며 AI 생태계를 함께 구축해 나가는 모습을 보입니다. 이러한 협력은 AI 기술의 발전 속도를 더욱 가속화할 것입니다.

* 미래 예측: 앞으로는 더욱 크고 강력하며, 다양한 모달리티를 처리하고, 특정 분야에 특화된 AI 모델이 등장할 것으로 예상됩니다. 또한, 모델의 효율성과 안전성이 더욱 중요해지며, 업계의 협력과 공유를 통한 지속적인 발전이 이루어질 것으로 예상됩니다. 개인정보보호 및 윤리적인 문제에 대한 고려도 더욱 중요해질 것입니다.

월간 인사이트:

지난 달과 이번 달 트렌드 순위 비교 분석을 통해, 코드 생성 및 처리 분야(Qwen, OpenCoder, Llama) 모델들의 지속적인 성능 향상과 다양한 크기의 모델 출시를 확인할 수 있습니다. 이는 개발자의 다양한 요구사항 충족을 위한 업계 경쟁 심화를 의미합니다.

이미지 생성 모델(FLUX, Stable Diffusion)은 품질 향상과 함께 리소스 효율성 개선에 초점을 맞추고 있습니다. 이는 모델의 접근성 확대 및 상용화 가능성 증대를 시사합니다.

음성 관련 모델(Hertz, OuteTTS, Whisper)은 실시간 처리 속도 향상과 다국어 지원 확대에 집중하며, 실제 서비스 적용 가능성이 높아지고 있음을 보여줍니다.

3D 모델 생성(Hunyuan3D, TRELLIS) 분야는 텍스트 및 이미지를 입력으로 활용하는 기술이 발전하며, 메타버스 및 게임 산업과의 시너지를 예상할 수 있습니다.

비디오 생성 모델(CogVideoX, Mochi, LTX-Video)의 등장은 고품질 비디오 생성 기술의 발전을 의미하며, 영상 콘텐츠 제작 및 편집 분야의 혁신을 예고합니다.

다중 모달 모델(Omnivision, Llama-3.2-Vision, InternVL)의 발전은 이미지와 텍스트를 통합적으로 처리하는 기술의 성숙을 의미하며, 다양한 산업 분야에서의 응용 가능성을 확장합니다.

대규모 언어 모델(LLM)의 지속적인 성능 향상과 함께, 사전 훈련 데이터셋(Common Corpus, FineWeb, Wikipedia)의 중요성이 더욱 커지고 있습니다. 고품질 데이터 확보가 향후 LLM 경쟁의 핵심 요소가 될 것입니다.

오픈소스 모델의 활발한 개발과 공유는 AI 기술의 민주화를 가속화하고 있으며, 개발자 커뮤니티의 활성화를 통해 기술 발전 속도를 더욱 높일 것으로 예상됩니다.

특정 분야에 특화된 모델(코드 생성, 이미지 생성, 음성 합성 등)의 출현은 AI 기술의 세분화를 의미하며, 각 분야별 전문성을 요구하는 시장의 확대를 예측할 수 있습니다.

모델 경량화 및 효율성 향상(SmolLM, OmniAudio)에 대한 노력은 모바일 및 에지 기기 환경에서의 AI 기술 적용을 확대할 것으로 예상됩니다.

다양한 벤치마크 및 평가 데이터셋(MMLU, GSM8K, ProcessBench)의 개발은 모델 성능 비교 및 개선을 위한 객관적인 기준을 제공하며, AI 기술의 신뢰성 향상에 기여할 것으로 보입니다.

라이선스 정책(Apache 2.0, MIT, CC-BY-NC 등)의 다양화는 오픈소스 모델의 활용 방식에 대한 다양한 선택지를 제공하며, 상업적 활용 가능성 확대와 동시에 윤리적 사용에 대한 고민을 필요로 합니다.

분기 인사이트:

LLM(대규모 언어 모델) 분야: 과거에는 70B 파라미터의 Reflection Llama-3.1과 같은 대규모 모델이 최첨단이었으나, 현재는 Meta의 Llama 3.3-70B-Instruct, DeepSeek-V2.5-1210, Qwen2.5-Coder-32B-Instruct 등 더욱 크고 성능이 향상된 모델들이 등장했습니다. 특히 코드 생성, 다국어 지원, 추론 능력이 강화된 모델들이 주목받고 있으며, 소형화된 고성능 모델에 대한 연구도 활발합니다. 미래에는 더욱 효율적이고 강력한 LLM이 등장하여 다양한 분야에서 활용될 것으로 예상됩니다. 또한, 모델의 안전성과 윤리적인 문제에 대한 관심이 증가하고 있으며, 이를 해결하기 위한 연구가 더욱 중요해질 것으로 예상됩니다.

이미지 생성 모델 분야: 과거에는 FLUX.1-dev와 같은 120억 매개변수 모델이 주목받았으나, 현재는 Stable Diffusion 3.5 Large와 같이 이미지 품질과 프롬프트 이해 능력이 더욱 향상된 모델들이 등장했습니다. 특히, 고해상도 이미지 생성, 다양한 스타일 제어, 실시간 이미지 생성 기술이 발전하고 있으며, 비디오 생성 모델인 HunyuanVideo와 같은 모델도 등장하여 멀티모달 생성 모델의 가능성을 보여주고 있습니다. 미래에는 더욱 사실적이고 다양한 스타일의 이미지와 비디오를 생성하는 모델들이 개발될 것으로 예상됩니다. 또한, 생성 과정의 효율성 향상과 에너지 소비 감소에 대한 연구가 중요해질 것으로 예상됩니다.

음성 처리 모델 분야: 과거에는 Fish Speech 1.4와 같은 70만 시간의 데이터로 학습된 TTS 모델이 최첨단이었지만, 현재는 Fish Speech 1.5와 같이 100만 시간 이상의 데이터로 학습된 더욱 고품질의 다국어 TTS 모델들이 등장했습니다. 또한, 실시간 음성 대화 기능을 갖춘 Mini-Omni와 같은 멀티모달 모델도 개발되고 있습니다. 미래에는 더욱 자연스럽고 정확한 음성 인식 및 합성 기술이 개발되어 다양한 언어와 억양을 지원하는 모델들이 등장할 것으로 예상됩니다. 또한, 개인 맞춤형 음성 합성 및 음성 클로닝 기술의 발전도 기대됩니다.

데이터셋 분야: 과거에는 LAION-Aesthetics V2와 같은 이미지 데이터셋이 많이 사용되었지만, 현재는 FineVideo와 같이 영상의 감정적 여정과 서사적 흐름을 포착하는 데 중점을 둔 고품질의 다중 모달 데이터셋이 등장하고 있습니다. 또한, 특정 분야에 특화된 데이터셋 (예: 법률 판례, 의료 데이터, 과학 논문)의 수요가 증가하고 있습니다. 미래에는 더욱 다양하고 고품질의 데이터셋이 개발되어 AI 모델의 성능 향상에 기여할 것으로 예상됩니다. 데이터의 편향성 문제 해결과 데이터 프라이버시 보호에 대한 관심이 더욱 높아질 것으로 예상됩니다.

기타: 과거에는 특정 플랫폼이나 연구 기관에서 개발된 모델들이 주로 사용되었지만, 현재는 Hugging Face와 같은 오픈소스 플랫폼을 통해 다양한 모델과 데이터셋이 공유되고 있습니다. 이러한 오픈소스 생태계의 확장은 AI 기술의 발전과 보급에 큰 영향을 미칠 것으로 예상됩니다. 또한, 모델의 효율성, 안전성, 윤리적인 측면에 대한 관심이 증가하고 있으며, 이러한 요소들을 고려한 모델 개발이 중요해지고 있습니다.